ICSEJOURNALICSEJOURNAL

Journal of Computer Science and Engineering (JCSE)Journal of Computer Science and Engineering (JCSE)Penelitian ini menanggapi kebutuhan mendesak akan sistem ringkasan dialog Bahasa Indonesia yang efisien dalam konteks kerja jarak jauh dengan mengadaptasi model multibahasa mBART-large-50. Dataset DialogSum diterjemahkan ke Bahasa Indonesia menggunakan Opus‑MT, dan dua pendekatan fine‑tuning, yaitu full fine‑tuning dan Parameter‑Efficient Fine‑Tuning (PEFT) dengan LoRA, dievaluasi. Eksperimen pada 1.500 sampel uji menunjukkan bahwa full fine‑tuning menghasilkan performa superior (ROUGE‑1: 0.3726), sementara PEFT mengurangi konsumsi energi sebesar 68,7 % dengan penurunan akurasi yang moderat (ROUGE‑1: 0.2899). Antarmuka berbasis Gradio memperlihatkan kegunaan praktis dengan memungkinkan perbandingan langsung antara model baseline, fine‑tuned, dan PEFT. Temuan kritis mencakup inkonsistensi terminologi yang disebabkan oleh terjemahan (misalnya, Hebes vs. Hebei) serta tantangan retensi konteks pada dialog panjang. Penelitian ini memberikan kerangka kerja skalabel untuk NLP bahasa sumber daya rendah serta wawasan aplikatif untuk mengoptimalkan efisiensi komputasi dalam aplikasi dunia nyata.

Penelitian ini berhasil mengembangkan sistem ringkasan dialog Bahasa Indonesia yang efisien dengan memanfaatkan model mBART melalui dua pendekatan fine‑tuning, yaitu full fine‑tuning yang memberikan performa tertinggi dan Parameter‑Efficient Fine‑Tuning (PEFT) yang mengurangi konsumsi energi hingga 68,7 % dengan penurunan akurasi moderat.Analisis menunjukkan adanya kendala seperti ketidaksesuaian istilah akibat terjemahan mesin serta kehilangan konteks pada dialog panjang, serta keterbatasan penggunaan metrik ROUGE tanpa penilaian manusia.Oleh karena itu, penelitian lanjutan direkomendasikan untuk mengembangkan strategi hybrid antara PEFT dan full fine‑tuning, membangun model pra‑latih khusus Bahasa Indonesia, serta memperluas evaluasi dengan penilaian manusia, dataset dialog asli, dan teknik kompresi model.

Penelitian lanjutan dapat diarahkan pada tiga bidang utama. Pertama, mengkaji strategi hybrid yang menggabungkan efisiensi PEFT dengan keunggulan performa full fine‑tuning, sehingga dapat memperoleh model yang akurat namun hemat energi. Kedua, mengembangkan model bahasa pra‑latih khusus Bahasa Indonesia yang dilatih pada korpus lokal, untuk meningkatkan kemampuan pemahaman konteks dan terminologi budaya pada tugas ringkasan dialog. Ketiga, membangun dataset dialog Bahasa Indonesia asli yang mencakup variasi topik dan panjang percakapan, serta melakukan evaluasi manusia secara menyeluruh untuk menilai kualitas ringkasan, sambil mengeksplorasi teknik adaptif seperti penyesuaian panjang urutan dan kompresi model agar dapat diterapkan pada perangkat dengan sumber daya terbatas. Kombinasi tiga arah penelitian ini diharapkan dapat memperkuat akurasi, efisiensi, dan kegunaan praktis sistem ringkasan dialog di lingkungan kerja nyata.

| File size | 617.79 KB |

| Pages | 11 |

| DMCA | Report |

Related /

UMGUMG Penelitian ini berfokus pada penggunaan sistem pendingin yang mengacu pada Itensitas Konsumsi Energi (IKE). Hasil audit pertama menunjukkan nilai 203,432/KWh/m²/tahun,Penelitian ini berfokus pada penggunaan sistem pendingin yang mengacu pada Itensitas Konsumsi Energi (IKE). Hasil audit pertama menunjukkan nilai 203,432/KWh/m²/tahun,

POLNAMPOLNAM Penelitian ini dimulai dengan analisis kebutuhan beban harian di Dusun I Negeri Hutumuri, termasuk kebutuhan rumah tangga, fasilitas umum seperti sekolahPenelitian ini dimulai dengan analisis kebutuhan beban harian di Dusun I Negeri Hutumuri, termasuk kebutuhan rumah tangga, fasilitas umum seperti sekolah

POLNAMPOLNAM Pemanfaatan solar cell sebagai sumber energi mengurangi ketergantungan pada listrik konvensional, menekan biaya operasional hingga 30–50%, serta menjadiPemanfaatan solar cell sebagai sumber energi mengurangi ketergantungan pada listrik konvensional, menekan biaya operasional hingga 30–50%, serta menjadi

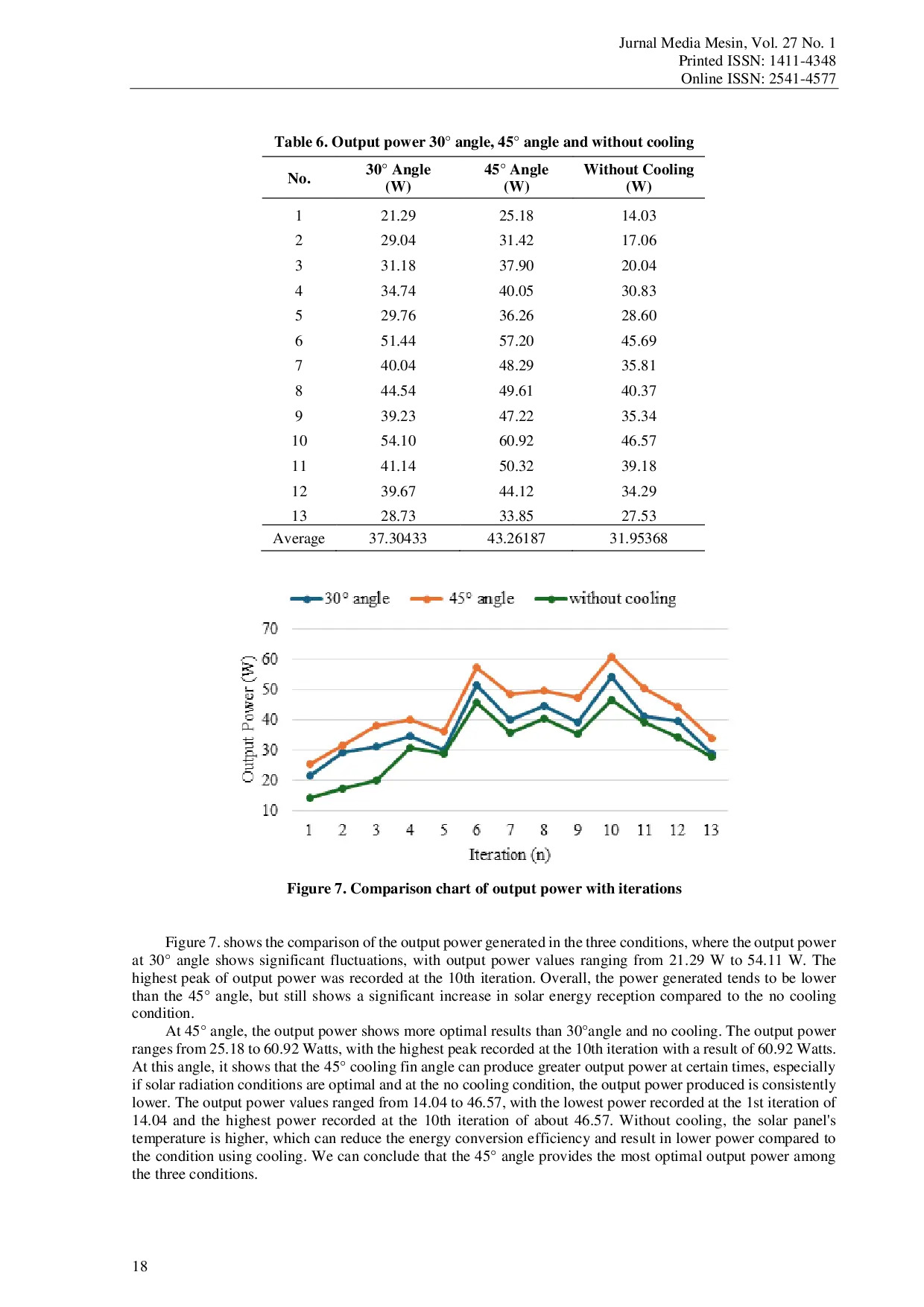

UMSUMS Penelitian ini menunjukkan bahwa sudut kemiringan sirip pendingin aluminium berpengaruh terhadap suhu kerja dan efisiensi panel surya. Sudut 45° memberikanPenelitian ini menunjukkan bahwa sudut kemiringan sirip pendingin aluminium berpengaruh terhadap suhu kerja dan efisiensi panel surya. Sudut 45° memberikan

STIALANBANDUNGSTIALANBANDUNG Hasil penelitian menunjukkan bahwa eROTA memenuhi empat karakteristik inovasi menurut Robbins, yaitu keunikan, unsur-unsur keunikan, proses yang direncanakan,Hasil penelitian menunjukkan bahwa eROTA memenuhi empat karakteristik inovasi menurut Robbins, yaitu keunikan, unsur-unsur keunikan, proses yang direncanakan,

MULIADARMAMULIADARMA Selain itu, teridentifikasi adanya kesenjangan penelitian mengenai model pengambilan keputusan yang adaptif untuk konteks e-commerce lokal di Indonesia.Selain itu, teridentifikasi adanya kesenjangan penelitian mengenai model pengambilan keputusan yang adaptif untuk konteks e-commerce lokal di Indonesia.

PUBLIKASIINDONESIAPUBLIKASIINDONESIA Hasil penelitian menunjukkan bahwa sistem civil law menekankan kepastian kontraktual dan prosedural, sedangkan sistem common law lebih fleksibel dalamHasil penelitian menunjukkan bahwa sistem civil law menekankan kepastian kontraktual dan prosedural, sedangkan sistem common law lebih fleksibel dalam

ASIANPUBLISHERASIANPUBLISHER Penelitian ini menggunakan metode studi literatur dengan menganalisis jurnal dan publikasi akademik yang membahas penerapan model Triple Helix dan pengembanganPenelitian ini menggunakan metode studi literatur dengan menganalisis jurnal dan publikasi akademik yang membahas penerapan model Triple Helix dan pengembangan

Useful /

UMGUMG Salah satu faktor penyebab kecelakaan adalah kendaraan yang tidak berkeselamatan dikarenakan ketidaktahuan pengemudi akan tata cara berkendara yang berkeselamatanSalah satu faktor penyebab kecelakaan adalah kendaraan yang tidak berkeselamatan dikarenakan ketidaktahuan pengemudi akan tata cara berkendara yang berkeselamatan

DCCKOTABUMIDCCKOTABUMI Tujuan utama dari sistem ini ialah membantu calon PMI untuk menentukan negara tujuan yang paling tepat berdasarkan berbagai kriteria yang relevan, sehinggaTujuan utama dari sistem ini ialah membantu calon PMI untuk menentukan negara tujuan yang paling tepat berdasarkan berbagai kriteria yang relevan, sehingga

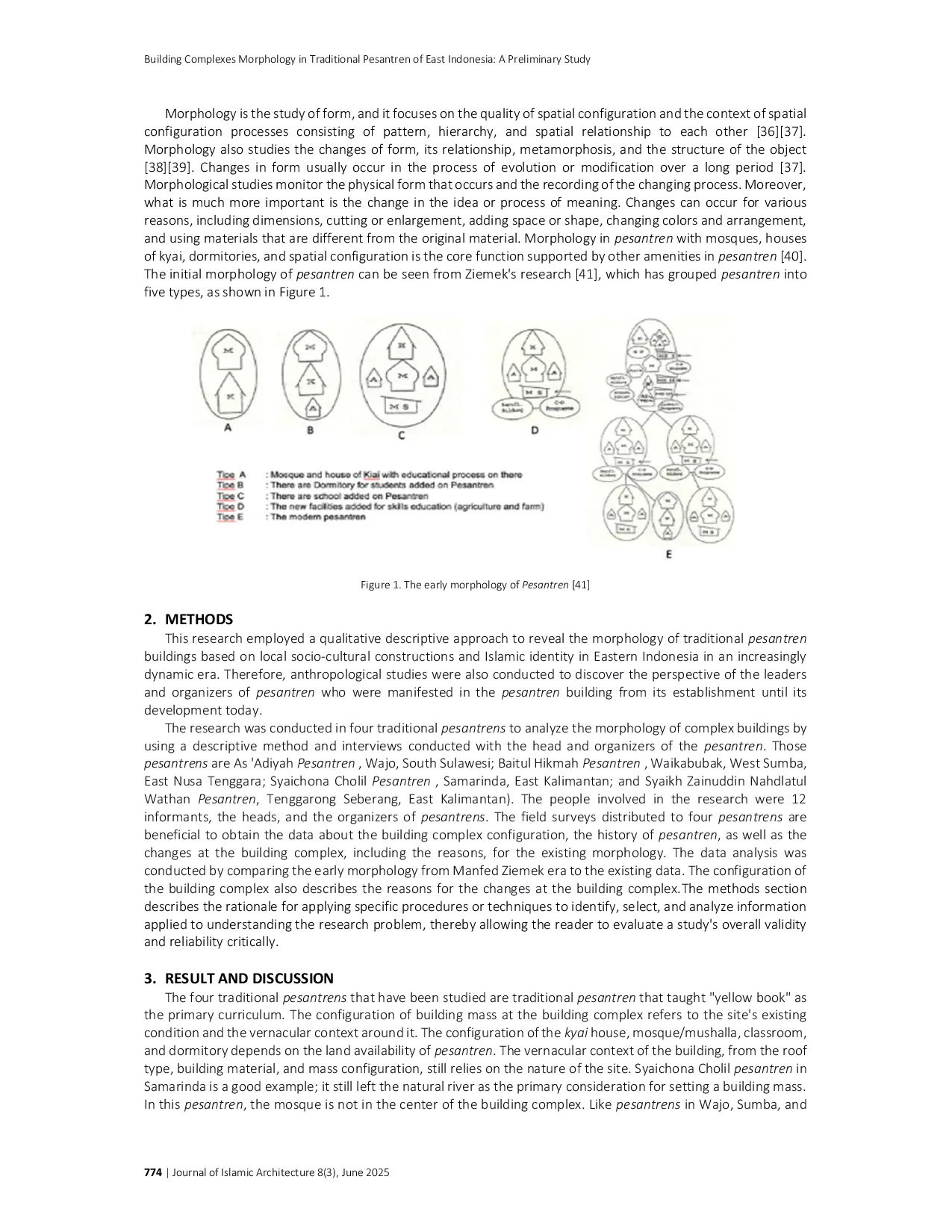

UIN MALANGUIN MALANG Penelitian menemukan bahwa semua morfologi pesantren tradisional tetap merujuk pada pesantren tradisional secara umum. Namun, terdapat beberapa modifikasiPenelitian menemukan bahwa semua morfologi pesantren tradisional tetap merujuk pada pesantren tradisional secara umum. Namun, terdapat beberapa modifikasi

UMGUMG Seluruh Dokumen telah tersimpan secara digital sehingga tidak diperlukan lagi biaya tambahan untuk proses penyimpanan Daftar Informasi Publik. AplikasiSeluruh Dokumen telah tersimpan secara digital sehingga tidak diperlukan lagi biaya tambahan untuk proses penyimpanan Daftar Informasi Publik. Aplikasi