PENERBITGOODWOODPENERBITGOODWOOD

Jurnal Ilmu Siber dan Teknologi DigitalJurnal Ilmu Siber dan Teknologi DigitalTwitter merupakan salah satu situs media sosial yang sedang berkembang pesat dengan lebih dari 3,7 juta pengguna aktif mem-posting sekitar 10 juta tweet per hari. Selain digunakan untuk update status, Twitter juga digunakan sebagai platform penyebaran informasi berbagai topik yang cukup akurat dan terpercaya. Pencarian tweet pada aplikasi Twitter dapat menggunakan fitur search dengan mengetikkan kata kunci atau hashtag. Akan tetapi, penggunaan kata kunci atau hashtag terkadang kurang akurat ketika menggunakan kata yang memiliki beberapa arti, sehingga, perlu dilakukan pemberian kategori terhadap tweet berdasarkan konteksnya untuk menghindari adanya bias pada kata yang memiliki beberapa arti serta meningkatkan ranking pada hasil pencarian Google. Pemrosesan bahasa alami (Natural Language Processing - NLP) merupakan cabang dari kecerdasan buatan (Artificial Intelligence) yang memberikan kemampuan pada komputer untuk memahami teks dan kata-kata yang diucapkan dengan cara yang sama seperti yang dapat dilakukan manusia. Klasifikasi teks merupakan salah satu tugas NLP yang dapat memberikan kategori terhadap teks secara otomatis berdasarkan konteks dari teks tersebut dengan bantuan metode machine learning maupun deep learning. Klasifikasi teks menjadi area penelitian yang sering muncul dalam pemrosesan bahasa alami karena meningkatnya jumlah unggahan pengguna di berbagai jejaring sosial. Proses pengklasifikasian teks dapat terbagi menjadi dua jenis, yaitu binary classification dan multiclass classification.

Pada penelitian ini telah dibahas mengenai model klasifikasi teks berbasis multiclass classification pada tweet berbahasa Indonesia yang diberi nama IndoBERT-LSTM.Adapun kesimpulan yang dapat diambil dari penelitian yang telah dilakukan yaitu.Berdasarkan hasil pengujian dan perbandingan, kombinasi model pre-trained IndoBERT dan Long Short-Term Memory (LSTM) terbukti dapat memberikan pemahaman yang lebih baik dalam mengklasifikasikan teks, baik pada dataset yang tidak termodifikasi maupun dataset yang telah termodifikasi.Model IndoBERT-LSTM dengan skenario kombinasi hyperparameter terbaik (batch size sebesar 16, learning rate sebesar 2e-5, dan menggunakan average pooling) berhasil mendapatkan F1-score sebesar 98,90% pada dataset yang tidak termodifikasi (peningkatan 0,70% dari model Word2Vec-LSTM dan 0,40% dari model fine-tuned IndoBERT) dan 92,83% pada dataset yang telah termodifikasi (peningkatan 4,51% dari model Word2Vec-LSTM dan 0,69% dari model fine-tuned IndoBERT).Peningkatan performa model IndoBERT-LSTM dari model fine-tuned IndoBERT tidak terlalu signifikan.Total waktu pelatihan model Word2Vec-LSTM masih jauh lebih cepat, yaitu sekitar 3 menit untuk kedua dataset, dibandingkan dengan model IndoBERT-LSTM yang membutuhkan waktu sekitar 30 dan 45 menit.Akan tetapi, model IndoBERT-LSTM masih lebih cepat jika dibandingkan dengan model fine-tuned IndoBERT yang membutuhkan waktu sekitar 40 dan 55 menit.

Saran untuk penelitian-penelitian berikutnya bisa mengombinasikan IndoBERT dengan metode pengklasifikasi yang lebih bervariasi, seperti Convolutional Neural Network (CNN), Bidirectional Long Short-Term Memory (Bi-LSTM), atau dengan melatih model pada multiclass dataset berbasis emosi atau sentimen karena memiliki tingkat pemahaman bahasa yang lebih sulit.

- Jurnal RESTI (Rekayasa Sistem dan Teknologi Informas)i. identifying emotion indonesian tweets neural... doi.org/10.29207/RESTI.V5I3.3137Jurnal RESTI Rekayasa Sistem dan Teknologi Informas i identifying emotion indonesian tweets neural doi 10 29207 RESTI V5I3 3137

- Chinese Text Classification Method Based on BERT Word Embedding | Proceedings of the 2020 5th International... dl.acm.org/doi/10.1145/3395260.3395273Chinese Text Classification Method Based on BERT Word Embedding Proceedings of the 2020 5th International dl acm doi 10 1145 3395260 3395273

| File size | 2.19 MB |

| Pages | 28 |

| DMCA | Report |

Related /

PENERBITGOODWOODPENERBITGOODWOOD Data sensor dapat dipantau dari jarak jauh melalui smartphone menggunakan aplikasi BLYNK. Sistem ini juga memungkinkan kontrol manual terhadap tindakanData sensor dapat dipantau dari jarak jauh melalui smartphone menggunakan aplikasi BLYNK. Sistem ini juga memungkinkan kontrol manual terhadap tindakan

UNIMAUNIMA Penelitian ini menyimpulkan bahwa generasi muda di Desa Tonsewer lebih banyak menggunakan Bahasa Melayu Manado daripada Bahasa Tontemboan, yang mengindikasikanPenelitian ini menyimpulkan bahwa generasi muda di Desa Tonsewer lebih banyak menggunakan Bahasa Melayu Manado daripada Bahasa Tontemboan, yang mengindikasikan

UNIMAUNIMA Selain itu, penggunaan bahasa gaul juga menjadi salah satu alasan bahwa penggunaan bahasa Indonesia sebagai alat komunikasi dalam kehidupan sehari-hariSelain itu, penggunaan bahasa gaul juga menjadi salah satu alasan bahwa penggunaan bahasa Indonesia sebagai alat komunikasi dalam kehidupan sehari-hari

AKMICIREBONAKMICIREBON Pengiriman kontainer ke dalam darat merupakan komponen penting dalam rantai logistik maritim global, berfungsi sebagai fase akhir menuju tujuan akhir diPengiriman kontainer ke dalam darat merupakan komponen penting dalam rantai logistik maritim global, berfungsi sebagai fase akhir menuju tujuan akhir di

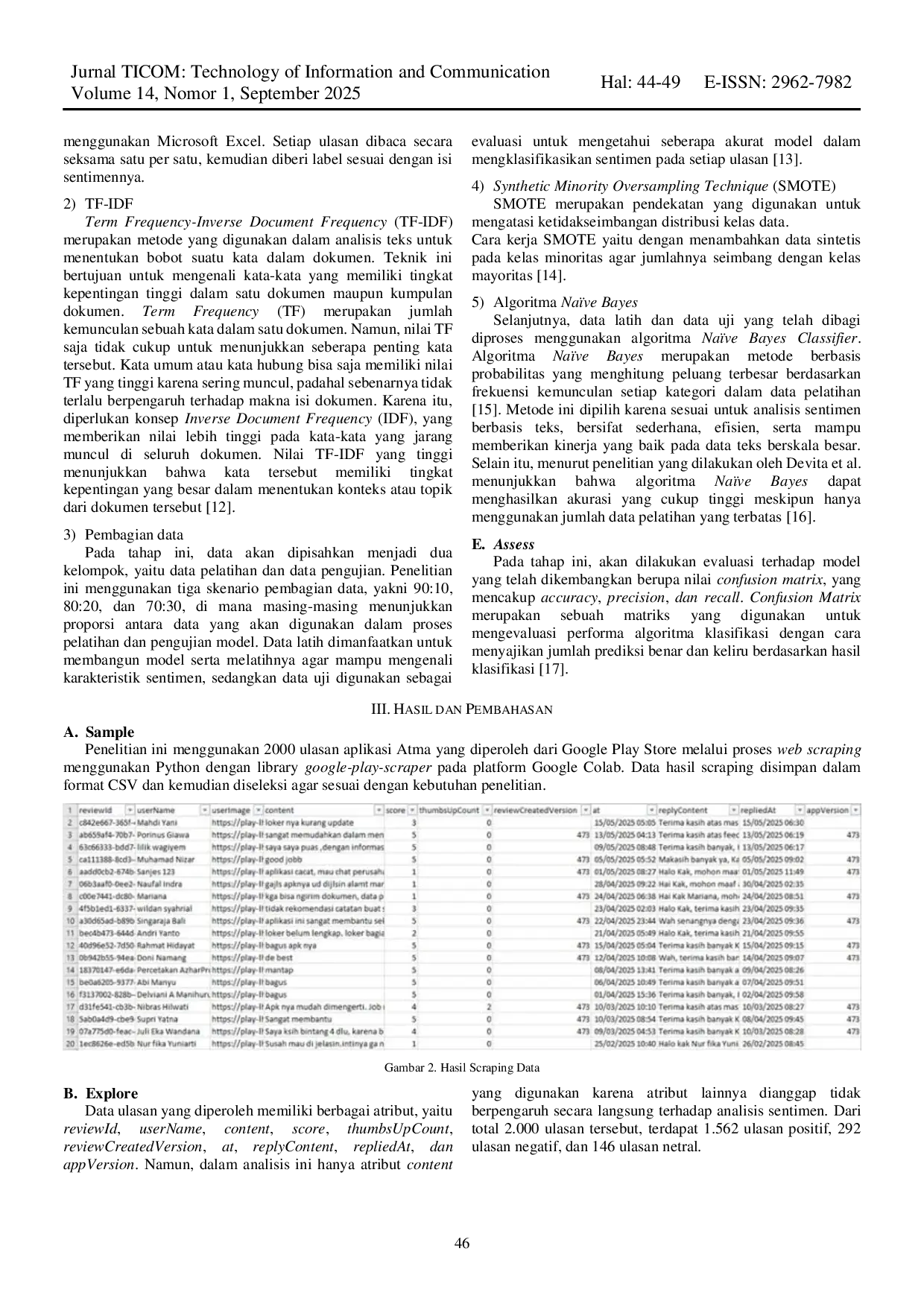

APTIKOMAPTIKOM Akurasi tertinggi yang dicapai adalah sebesar 85,56% dengan proporsi 90% data latih dan 10% data uji. Temuan ini menunjukkan bahwa kombinasi Naïve Bayes,Akurasi tertinggi yang dicapai adalah sebesar 85,56% dengan proporsi 90% data latih dan 10% data uji. Temuan ini menunjukkan bahwa kombinasi Naïve Bayes,

MEDIAPUBLIKASIMEDIAPUBLIKASI Penelitian ini menghasilkan model prediksi keberhasilan mahasiswa menggunakan algoritma machine learning yang terbukti efektif dalam mengklasifikasikanPenelitian ini menghasilkan model prediksi keberhasilan mahasiswa menggunakan algoritma machine learning yang terbukti efektif dalam mengklasifikasikan

UNESAUNESA The findings indicate that collaboration between government, private businesses, and the community strengthens the environmental movements institutionalThe findings indicate that collaboration between government, private businesses, and the community strengthens the environmental movements institutional

UNESAUNESA The objective of this study is to examine the portrayal of domestic violence in the 2023 Korean drama series The Glory. A comprehensive data set was collectedThe objective of this study is to examine the portrayal of domestic violence in the 2023 Korean drama series The Glory. A comprehensive data set was collected

Useful /

POLTEK KAMPARPOLTEK KAMPAR Kesimpulan yang dapat diberikan berdasarkan hasil pengukuran pada Mesin Pencacah Tongkol Jagung di PT Multindo Anugerah Perkasa. Total efektivitas dariKesimpulan yang dapat diberikan berdasarkan hasil pengukuran pada Mesin Pencacah Tongkol Jagung di PT Multindo Anugerah Perkasa. Total efektivitas dari

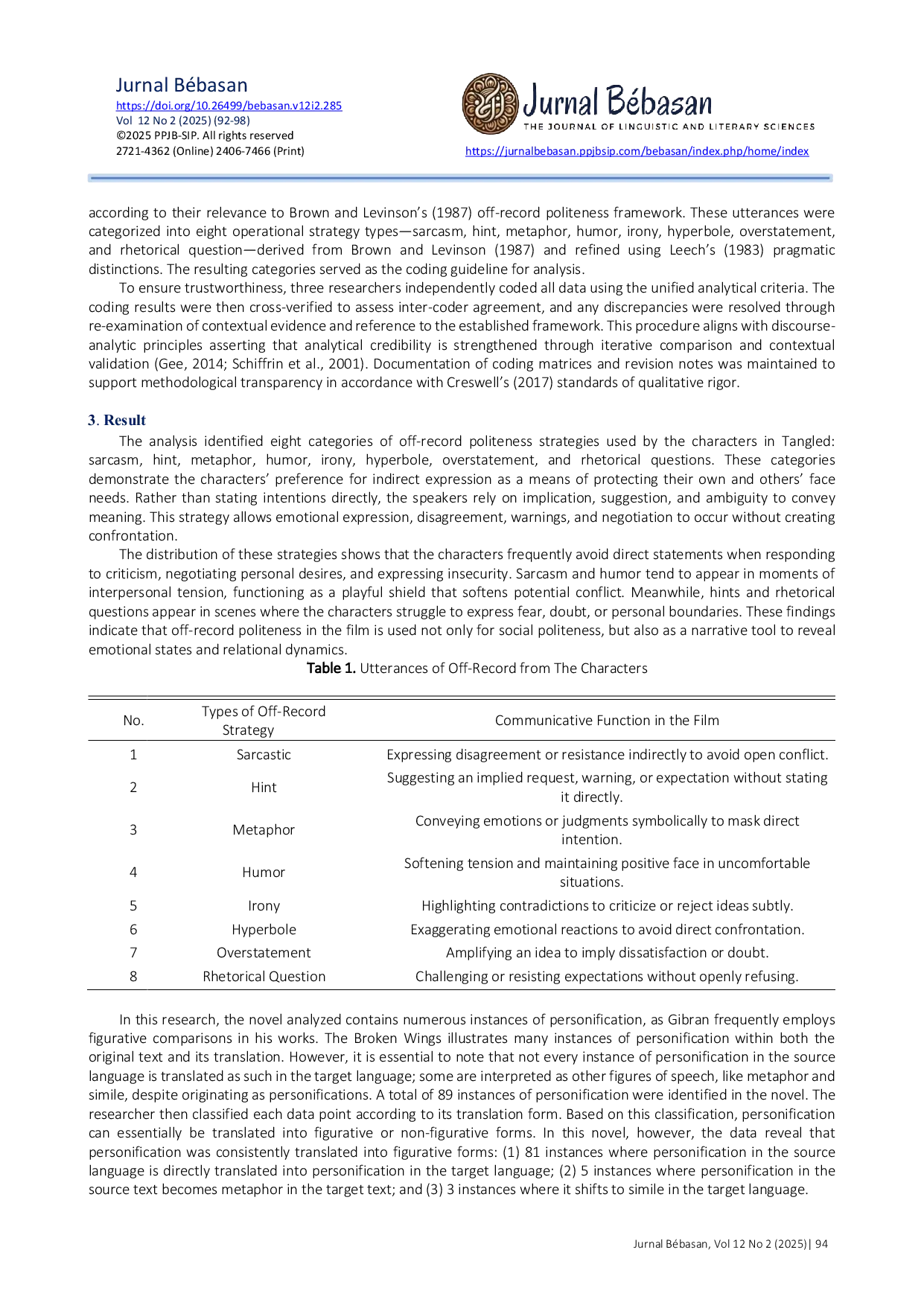

PPJBSIPPPJBSIP Sehingga, strategi off-record tidak hanya melindungi wajah tetapi juga membangun otoritas, jarak emosional, atau solidaritas, tergantung pada siapa yangSehingga, strategi off-record tidak hanya melindungi wajah tetapi juga membangun otoritas, jarak emosional, atau solidaritas, tergantung pada siapa yang

POLTEK KAMPARPOLTEK KAMPAR Sebagai solusi, maka dibangun. Tujuan dibuatnya sistem ini untuk memberikan informasi kepada petani kelapas sawit mengenai perubahan kadar gas metana danSebagai solusi, maka dibangun. Tujuan dibuatnya sistem ini untuk memberikan informasi kepada petani kelapas sawit mengenai perubahan kadar gas metana dan

UJBUJB Dampak dari pernikahan usia dini ini sangat berbahaya bagi keluarga maupun negara, termasuk putus sekolah, pergaulan terbatas, disharmoni keluarga, danDampak dari pernikahan usia dini ini sangat berbahaya bagi keluarga maupun negara, termasuk putus sekolah, pergaulan terbatas, disharmoni keluarga, dan